RCS诊断成像系统的算力破局之道:从电磁仿真到高分辨反演的全链路硬件配置指南

时间:2026-03-10 22:53:03

来源:UltraLAB图形工作站方案网站

人气:102

作者:管理员

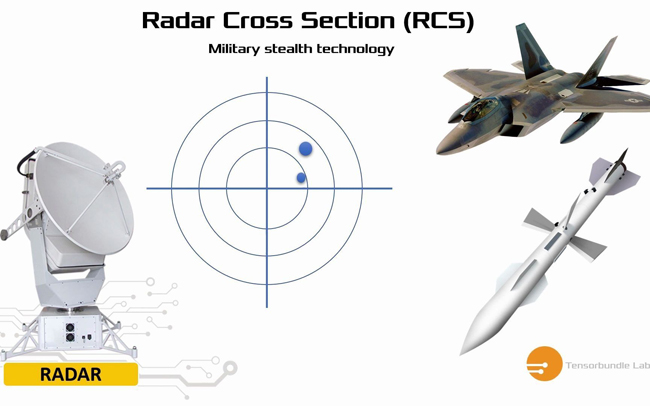

RCS(Radar Cross Section)诊断成像是现代隐身目标设计与电磁散射机理研究的核心技术手段。通过宽带宽角散射数据的采集与处理,该技术能够精准定位战机、舰船等目标的强散射源("热点"),为隐身优化提供量化依据。然而,从电大尺寸的复杂目标电磁仿真到高分辨成像反演,全流程涉及海量矩阵运算、频域-空域数据耦合处理以及三维傅里叶变换等计算密集型任务。本文基于RCS诊断成像的技术流程(参数计算→仿真计算→轮廓提取→成像),深度解析其计算瓶颈,并提供针对性的软硬件配置方案。

一、主要计算瓶颈:电磁CAE的"三座大山"

RCS诊断成像的完整流程包含电磁仿真数据获取与成像反演两大阶段,每个阶段都存在显著的算力壁垒:

1.1 电磁全波仿真:内存与时间的双重绞杀

瓶颈描述:获取宽带宽角RCS数据需对目标进行全波电磁仿真。以战斗机(电大尺寸目标,典型尺寸10m,X波段频率10GHz)为例:

-

网格剖分:按每波长10个单元计算,表面网格量达500万-2000万单元,体网格可能突破1亿单元

-

扫频计算:宽带RCS(如2-18GHz)需计算数百个频点,每个频点求解一次大型线性方程组(MoM/MLFMM算法)

-

内存占用:多层快速多极子(MLFMM)算法虽降低复杂度,但电大目标仍需128GB-512GB物理内存存储阻抗矩阵与预条件子

-

角度扫描:周向360°每1°一步计算,共360组入射角度,形成"频率-角度"二维数据矩阵(数据量可达TB级)

硬件敏感点:内存容量 > 内存带宽 > 单核性能(频域求解器通常并行效率受限)

1.2 成像反演算法:计算复杂度的指数级挑战

文章提及的三种核心算法各有计算痛点:

距离多普勒算法(ImageRD):

-

依赖FFT快速实现,但宽带高分辨要求超大点数的FFT(如8192×8192),对内存带宽极度敏感

-

距离徙动校正(RCMC)需要复杂插值,随机内存访问模式导致缓存命中率低

逆向投影算法(ImageBP):

-

计算复杂度O(N³):对每个成像像素点,需遍历所有频率-角度单元进行相位补偿与积分

-

运算类型:双精度复数乘加(Complex Multiply-Accumulate),依赖CPU的浮点单元(FPU)吞吐量

-

内存瓶颈:需同时驻留全频段RCS数据矩阵(数十GB),内存不足时触发磁盘交换(Thrashing),性能暴跌

相位滤波成像算法(ImageFPA):

-

涉及多次二维傅里叶变换与频域滤波,计算密度高,适合向量化运算(AVX-512)

1.3 数据I/O与后处理瓶颈

-

原始数据规模:一次完整的战斗机RCS诊断仿真可产生500GB-2TB的原始场数据(.efe/.hfe文件)

-

中间文件交换:电磁仿真软件(FEKO/CST)与MATLAB/Python成像程序间的数据格式转换(如.touchstone/.mat文件)需要高速磁盘

-

可视化渲染:高分辨成像结果(4096×4096像素)的伪彩色渲染与三维热点叠加显示,对显卡有较高要求

二、软件工具链与系统环境配置

2.1 操作系统选择

推荐配置:Linux CentOS 8.x/Rocky Linux 9.x(服务器/工作站场景)或 Windows 11 Pro for Workstations(个人桌面场景)

选择逻辑:

-

电磁仿真软件(FEKO、CST、HFSS)的Linux版本通常支持更大内存(>2TB)和更优的MPI并行效率

-

MATLAB for Linux在内存管理(Large Arrays)上比Windows版本更稳定

-

成像算法开发推荐Linux环境,便于对接Python/NumPy/CUDA工具链

2.2 核心软件栈

| 功能模块 | 推荐软件 | 版本/配置要点 | 许可模式 |

|---|---|---|---|

| 电磁仿真 | Altair FEKO | 2023.1+(支持OpenMP/MPI混合并行) | 浮动许可(HPC Pack需单独购买) |

| CST Studio Suite | 2024(时域/频域求解器) | 节点锁定或浮动 | |

| ANSYS HFSS | 2023 R2(SBR+求解器适合超电大目标) | 按核心数授权 | |

| 编程环境 | MATLAB | R2023b+(Parallel Computing Toolbox必备) | 网络许可 |

| Python | 3.11+(NumPy 1.24+,SciPy,Matplotlib) | 开源 | |

| Intel oneAPI | 2024(MKL数学库,IPP图像处理) | 免费社区版 | |

| 成像算法 | 自研代码 | 基于《雷达目标特性及MATLAB仿真》附录源码优化 | - |

| 可视化 | ParaView | 5.11+(用于三维RCS热点云图渲染) | 开源 |

| Tecplot 360 | 2023(专业电磁数据可视化) | 商业许可 |

2.3 软件优化策略

-

FEKO并行配置:在

editfeko中设置*option卡片,启用MLFMM的多线程加速(num_threads参数匹配物理核心数) -

MATLAB内存优化:启动参数添加

-singleCompThread避免多线程冲突,或利用distributed工具箱进行多机并行成像处理 -

Python性能加速:使用Numba对BP算法中的嵌套循环进行JIT编译,或改写为Cython扩展

三、硬件配置推荐方案

基于RCS诊断成像"高频强单核性能+海量内存+高IO吞吐"的需求特征,提供三级配置方案:

方案A:个人研发工作站(适用于硕士/博士课题研究)

适用场景:简化模型(导弹、无人机部件),频率<10GHz,网格量<500万

配置清单:

-

CPU:Intel Core i9-14900K(24核32线程,6.0GHz睿频)或 AMD Ryzen 9 9950X3D(16核32线程,5.7GHz,3D V-Cache提升缓存命中率)

-

内存:128GB DDR5-6000 ECC(双通道,高频内存加速FFT)

-

存储:2TB NVMe Gen4 SSD(系统+软件)+ 4TB NVMe Gen4 SSD(仿真数据缓存)

-

显卡:NVIDIA RTX 4080 Super 16GB(加速CST时域求解,支持DLSS可视化)

-

系统:Windows 11 Pro + WSL2(Ubuntu子系统运行Linux版FEKO)

性能预期:单频点RCS计算(MLFMM)约15-30分钟,二维成像反演(1024×1024像素)<5分钟。

方案B:部门级电磁仿真工作站(适用于院所研究室)

适用场景:整机RCS(战斗机、舰船),X/Ku波段,网格量2000万-1亿,需 Overnight 连续计算

配置清单:

-

CPU:AMD Threadripper PRO 7975WX(32核64线程,4.0GHz基频,5.3GHz Boost,8通道内存)

-

选择理由:sTR5平台支持2TB内存扩展,8通道DDR5提供>300GB/s带宽,匹配MLFMM的内存吞吐需求

-

-

内存:512GB DDR5-4800 ECC RDIMM(8×64GB,满通道配置,预留8槽位扩展至1TB)

-

存储:

-

系统盘:1TB NVMe Gen4(三星PM9A3,企业级DWPD)

-

数据盘:8TB Intel P5800X Optane SSD(随机读写IOPS 150万,应对FEKO大量小文件IO)

-

归档盘:16TB SATA HDD(RAID 1,存储历史RCS数据)

-

-

显卡:NVIDIA RTX 6000 Ada 48GB(双精度浮点性能占优,适合复杂后处理)

-

系统:Linux CentOS 8.6(内核优化:增大

vm.max_map_count至262144,满足FEKO大内存映射需求)

性能预期:支持X波段战斗机全频段(8-12GHz)80个频点、360角度RCS计算(总计算量约500核时),内存峰值占用约380GB,总耗时<12小时。

方案C:集群级RCS诊断计算平台(适用于国家级重点实验室)

适用场景:超电大目标(航母、空间站),太赫兹频段,参数化扫描(气动-电磁耦合),多目标并行成像

架构设计:

-

登录/前处理节点:

-

CPU:双路Intel Xeon Gold 6448Y(32核/路,2.1GHz,睿频4.1GHz)

-

内存:512GB DDR5-4800(用于CAD模型导入、网格剖分)

-

显卡:NVIDIA RTX A4000(4屏输出,几何建模)

-

-

高频计算节点(电磁仿真专用):

-

CPU:双路AMD EPYC 9654(96核/路,3.7GHz Boost,12通道DDR5)

-

内存:2TB DDR5-4800(24×128GB,满足1.5亿网格MLFMM计算)

-

网络:NVIDIA ConnectX-6 200GbE InfiniBand(支持RDMA,减少并行计算通信延迟)

-

存储:本地480GB NVMe(OS)+ 挂载Lustre并行文件系统(100TB+,应对TB级RCS数据)

-

-

成像处理节点(算法反演专用):

-

CPU:双路Intel Xeon W7-3465X(28核/路,4.8GHz睿频,高主频优化BP算法)

-

内存:1TB DDR5-4800

-

GPU:4×NVIDIA A100 80GB PCIe(CUDA加速ImageBP算法,GPU Direct Storage高速IO)

-

专用配置:安装Intel oneAPI MKL,利用AVX-512指令集加速FFT运算

-

-

作业调度:Slurm 23.02,配置RCS仿真队列(单节点独占)与成像队列(GPU资源池)

性能预期:可在24小时内完成Ka波段(26.5-40GHz)全极化、全角度(0.1°步进)的隐身战机RCS数据库构建(数据量>2TB),并在一小时内完成超分辨成像(8192×8192像素)。

四、关键硬件选型深度解析

4.1 为何选择AMD Threadripper PRO而非双路EPYC?

RCS诊断成像的电磁仿真阶段(FEKO/CST)往往并行效率随核心数增加而递减(Amdahl定律限制,串行部分占10-20%)。Threadripper PRO 7975WX单路高主频(4.0GHz基频)相比双路EPYC(2.0-3.0GHz基频)在单节点计算时:

-

单核性能领先35%:频域求解器的矩阵填充阶段受益明显

-

避免NUMA延迟:双路服务器的跨Socket内存访问延迟(>100ns)会拖慢MLFMM的近场矩阵计算

-

成本优势:单路主板+CPU成本约为同核数双路系统的60%

4.2 内存配置的黄金法则

RCS诊断成像的内存需求可通过以下公式估算:

plain

内存需求(GB) ≈ 网格数(百万) × 系数(8-12) + 角度数 × 频点数 × 采样点 × 16字节

对于1亿网格、360角度、100频点、每频点采样1000点的典型任务:

-

电磁仿真:1亿×10 = 100GB(MLFMM近场矩阵)

-

数据存储:360×100×1000×16 = 576MB(RCS数据)

-

成像反演:需同时驻留全矩阵,建议512GB-1TB配置

技术细节:务必选择RDIMM(Registered DIMM)而非UDIMM,确保信号完整性;启用BIOS中的Node Interleaving(如使用双路)或Channel Interleaving(单路)以最大化带宽。

4.3 存储系统的"热-温-冷"分层

-

热层(Hot):Intel Optane P5800X 3.2TB,存放正在计算的FEKO项目(.cfx文件、.efe/.hfe临时文件),随机读写IOPS 150万,延迟<10μs

-

温层(Warm):三星PM893 7.68TB SATA SSD,存放已完成但未归档的RCS数据(.mat、.touchstone)

-

冷层(Cold):机械硬盘RAID 6阵列,用于长期归档(>5年保存期)

五、总结:算力即诊断精度

RCS诊断成像的精度直接受限于频率带宽与角度范围,而这两者都受限于算力。当硬件配置从128GB内存升级至512GB,可支持的网格数从2000万跃升至1亿,成像分辨率从"米级"提升至"厘米级",真正识别出隐身战机的细微缝隙强散射源。

UltraLAB针对电磁CAE领域的计算特性,提供高频静音工作站与大内存服务器的定制化解决方案。我们的工程师熟悉FEKO/CST/HFSS的并行优化参数,可为您的RCS诊断成像项目提供从单台桌面超算到百节点集群的全栈硬件支持,让电磁散射的"黑箱"在算力面前无处遁形。

【UltraLAB 解决方案事业部】

咨询专线:400-7056-800

微信号:xasun001

上一篇:没有了