当通达信遇见微软Qlib:AI量化策略的算力基建与工程实践

时间:2026-03-24 09:47:40

来源:UltraLAB图形工作站方案网站

人气:90

作者:管理员

"数据已来,AI已来"——当通达信TDXQuant的几行代码就能调取十年历史行情,当微软亚洲研究院的Qlib平台将量化流程封装成"AI工厂",散户量化投资的门槛从"爬数据+写回测+调模型"的数月工作量,压缩到了20分钟跑通策略。

但这只是开始。当你试图加载全市场5000只股票、计算1000个Alpha因子、用LightGBM做滚动窗口训练时,Pandas的内存溢出、LightGBM的训练耗时、回测的CPU瓶颈会迅速让你意识到:AI量化不仅是算法竞赛,更是算力基建的较量。

本文将深度拆解Qlib+TDXQuant技术栈的核心计算特征与硬件优化方案,帮助量化研究者从"跑通Demo"迈向"生产级策略"。

一、核心技术架构:从数据流到策略生产的全链路

1. 数据层:通达信TDXQuant的高性能数据管道

技术实现:

-

COM接口/Python绑定:通过

pytdx或tdx-center库直接调用通达信本地数据,绕过网络爬虫的不稳定性 -

二进制格式转换:Qlib proprietary格式(

.bin文件)比CSV快50倍,采用内存映射(mmap)技术实现O(1)数据访问 -

增量更新机制:仅需下载当日数据并合并至本地仓库,避免全量重复下载

关键技术细节:

Python

# 数据转换的核心:从通达信DataFrame到Qlib二进制 # Qlib要求特定的目录结构:calendars/features/instruments # 数据类型:float32(比float64节省50%内存,对深度学习至关重要)2. 计算层:Qlib表达式引擎与特征工厂

核心技术:

-

表达式引擎(Expression Engine):一行公式生成成百上千个因子,如

"Ref($close, 1)/$close - 1"(日收益率) -

自动特征工程:支持跨截面(cross-sectional)和时序(time-series)算子,自动处理缺失值与异常值

-

缓存机制:计算过的因子自动落盘,避免重复计算

计算特征:

-

向量化运算:基于NumPy的SIMD优化,单条表达式可并行处理全市场股票

-

内存密集型:计算

Std($returns, 20)(20日波动率)需保留前19日数据在内存中滑动窗口

3. 模型层:LightGBM的梯度提升训练

算法核心:

-

基于直方图的决策树算法:将连续特征离散化为256个bin,减少内存占用并加速训练

-

Leaf-wise生长策略:相比Level-wise,在相同节点数下获得更高精度,但需控制

max_depth防止过拟合 -

并行训练:支持Feature Parallel(特征并行)和Data Parallel(数据并行)

计算瓶颈:

-

CPU密集型:LightGBM主要依赖CPU,利用AVX2/AVX-512指令集加速直方图构建

-

缓存敏感:频繁访问特征直方图,需要高带宽低延迟的内存访问

4. 回测层:事件驱动与向量化混合引擎

技术特点:

-

双模式回测:支持事件驱动(Event-driven,精确模拟滑点)和向量化(Vectorized,快速筛选)

-

避免前视偏差(Look-ahead Bias):严格的时间戳对齐,确保

predict只使用t-1时刻及之前的数据 -

性能指标计算:夏普比率、最大回撤、信息比率等实时计算

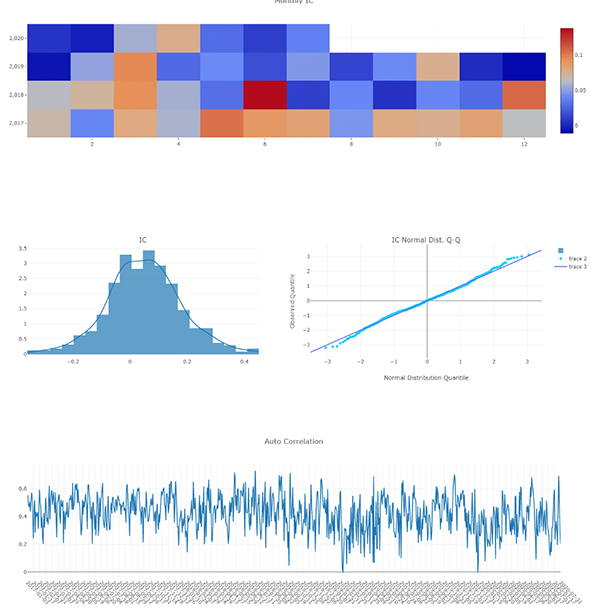

二、计算特征分析:为什么你的策略会"卡死"?

1. 内存墙:Pandas的瓶颈与Qlib的优化

问题场景:

-

全市场5000只股票×10年日线数据(约1200万行)× 1000个因子 = 48GB内存占用(float64)

-

Pandas的Index和GroupBy操作会产生大量内存拷贝,导致32GB内存轻松耗尽

Qlib的解决方案:

-

列式存储:按因子存储而非按股票存储,提高缓存命中率

-

内存映射(mmap):数据不加载进Python内存,直接通过操作系统缓存访问

-

Float32精度:相比Float64内存占用减半,对量化因子精度损失可忽略(<1e-6)

硬件需求:大内存(64GB+)是处理全市场因子的基础配置。

2. CPU密集型:LightGBM的训练负载

计算特征:

-

直方图构建:每次分裂需对所有特征分桶统计,时间复杂度 O(N×F×B) (N 样本数,F 特征数,B 桶数)

-

寻找最优分裂点:需遍历所有特征的所有桶,高度依赖CPU单核性能(无法完全并行)

性能数据:

-

在AMD Ryzen 9 7950X(16核)上训练1000棵树、100个因子、50万条样本,耗时约30-60秒

-

在Intel Xeon Platinum(高主频服务器CPU)上,相同时耗可提速20-30%

3. IO密集型:数据读取与特征缓存

瓶颈分析:

-

首次计算大量因子时,需从硬盘读取原始价格数据(通达信本地数据通常为数GB)

-

频繁的随机读取(Random Read)对机械硬盘(HDD)是灾难,SSD可将数据加载时间从分钟级降至秒级

4. 时序计算的依赖性:难以并行的挑战

技术难点:

-

因子计算如

Ref($close, 20)(20日前收盘价)具有强时序依赖,无法像图像识别那样任意并行 -

滚动窗口(Rolling Window)统计需按时间顺序滑动,多线程加速效果有限

三、应用场景:从ETF轮动到AI选股的算力需求分级

场景A:个人投资者/量化爱好者(轻量级)

应用描述:

-

跟踪10-50只ETF或个股

-

计算5-20个基础技术因子(收益率、成交量比、波动率、动量)

-

使用LightGBM/XGBoost做日频或周频调仓

-

回测周期1-3年

算力需求:

-

内存:16-32GB(Pandas可轻松处理)

-

CPU:中高主频(>3.5GHz),8核以上

-

存储:500GB NVMe SSD(存放通达信本地数据+Qlib二进制缓存)

-

GPU:非必须(LightGBM主要用CPU,深度学习才需GPU)

场景B:私募量化/FOF基金(中量级)

应用描述:

-

全市场A股(5000+)选股

-

计算500-1000个Alpha因子(包括基本面、技术指标、宏观因子)

-

滚动训练(Walk-forward Optimization):每周重训练模型

-

高频回测(分钟级)

算力需求:

-

内存:128GB+(处理全市场因子矩阵)

-

CPU:双路服务器,高主频(>3.8GHz)+ 多核(32核+),支持AVX-512

-

存储:2TB NVMe SSD(高速读写Qlib缓存文件)+ 10TB HDD(历史数据归档)

-

网络:低延迟连接交易所行情(如盛立、飞马系统)

场景C:AI深度学习策略(重量级)

应用描述:

-

使用Qlib集成的深度学习模型(LSTM、Transformer、GATs图注意力网络)

-

处理高频数据(Tick级,单日数据量>100GB)

-

多模型集成(Ensemble)与超参数搜索(Hyperparameter Tuning)

算力需求:

-

GPU:NVIDIA RTX 4090/5090或A100,显存24GB+(处理时序神经网络)

-

内存:256GB+(缓存大规模训练数据)

-

CPU:高主频(减少数据预处理瓶颈)

-

存储:全闪存阵列(NVMe-oF),处理高频Tick数据流

四、最佳硬件配置方案

方案A:Qlib策略研发工作站(个人/小型团队)

配置清单:

| 组件 | 推荐型号 | 技术要点 |

|---|---|---|

| CPU | AMD Ryzen 9 9950X (16C/32T, 5.7GHz) 或 Intel Core i9-14900K | 高主频优先:LightGBM训练依赖单核性能;多核支持并行回测 |

| 内存 | 64GB DDR5-6000 (2×32GB) | 双通道高频率,满足全市场50只ETF×100因子计算 |

| 存储 | 1TB NVMe PCIe 4.0 (系统) + 4TB NVMe (数据) | 存放通达信本地数据(通常2-3GB/年)+ Qlib二进制缓存 |

| 显卡 | RTX 4060 Ti 16GB (可选) | 如需尝试深度学习模型(LSTM),16GB显存可入门 |

| 散热 | 360mm水冷 | 9950X满载功耗170W+,需稳定散热保障持续训练性能 |

软件优化:

-

使用Anaconda管理Python环境(Qlib要求Python 3.7-3.12)

-

安装MKL优化版NumPy/Scikit-learn(Intel CPU)或OpenBLAS(AMD CPU),矩阵运算提速3-5倍

-

配置RamDisk:将Qlib的

features目录挂载到内存盘,因子读取速度提升10倍

推荐机型:UltraLAB AR350(静音水冷设计,适合家庭办公室,预装Qlib依赖环境)

方案B:生产级量化回测服务器(机构级)

配置清单:

| 组件 | 推荐型号 | 技术要点 |

|---|---|---|

| CPU | 双路 Intel Xeon Platinum 8592+ (128C/256T, 3.9GHz) | UPI互联保障双路一致性;AVX-512加速LightGBM直方图计算 |

| 内存 | 256GB DDR5-4800 ECC Reg (8×32GB) | ECC防止长时间训练中的内存错误;大容量支持全市场千因子计算 |

| 存储 | 4TB NVMe SSD (系统+软件) + 20TB RAID10 (数据) | RAID10保障数据安全;NVMe存储Qlib热数据 |

| 加速卡 | NVIDIA RTX A6000 48GB × 2 | 支持GPU加速的LightGBM(需编译GPU版本);深度学习模型训练 |

| 网络 | 万兆以太网 + 双网卡绑定 | 快速下载通达信数据更新;连接行情源 |

架构优化:

-

分层存储:热数据(近3年)存NVMe,冷数据(历史)存SAS硬盘

-

多实例并行:利用128核优势,同时运行10-20个策略的滚动回测

-

内存数据库:使用Redis缓存高频访问的因子数据,减少磁盘IO

推荐机型:UltraLAB GX660(4U机架式,支持双路CPU+多GPU,通过NVIDIA认证,预装TDXQuant+Qlib集成环境)

方案C:高频AI量化集群(顶级配置)

适用场景:Tick级数据处理、实时因子计算、深度学习超参搜索

异构计算架构:

plain

管理节点:Xeon W9-3575X + 128GB内存(策略研发)

计算节点(每节点):

- CPU: EPYC 9754 (128C) - 数据预处理

- GPU: H100 80GB × 8 - LSTM/Transformer训练

- 存储: 全闪存并行文件系统(WEKA/IBM GPFS)

- 网络: 200Gb/s InfiniBand(模型参数同步)五、工程实践:性能调优指南

1. 数据读取优化

问题:通达信数据转Qlib格式耗时过长 优化方案:

-

使用

multiprocessing并行处理多只股票 -

预先分配NumPy数组内存,避免动态扩容

-

采用

float32而非float64存储(Qlib默认)

2. LightGBM训练加速

参数调优:

Python

params = { 'num_leaves': 31, # 控制模型复杂度 'max_depth': 5, # 防止过拟合,同时减少计算量 'n_estimators': 100, 'learning_rate': 0.1, 'n_jobs': -1, # 使用全部CPU核心 'histogram_pool_size': 2048, # 限制直方图内存,避免OOM }

硬件利用:

-

确保LightGBM编译时启用AVX2/AVX-512(检查

lgb.basic.Booster的编译标志) -

对于超大规模数据(>100万条),使用特征并行(Feature Parallel)模式

3. 回测性能优化

向量化 vs 事件驱动:

-

向量化回测:适合快速筛选策略,利用NumPy批量计算,速度是事件驱动的100倍

-

事件驱动回测:精确模拟滑点与成交,适合最终验证,但需优化循环逻辑(使用Cython或Numba JIT编译)

六、UltraLAB AI量化算力解决方案

针对Qlib+TDXQuant技术栈的"内存密集型+CPU计算密集型"特性,UltraLAB推出QuantAI Series:

| 型号 | 定位 | 核心配置 | 适用场景 |

|---|---|---|---|

| A330 | 个人量化入门 | i9-14900K + 64GB + 2TB NVMe | ETF策略、50只以内选股、教学研究 |

| AR350 | 专业策略研发 | 9950X + 128GB + RTX 4070 Ti Super | 全市场回测、LightGBM滚动训练 |

| GX660M | 机构生产环境 | 双路Xeon + 256GB + A6000×2 | 多策略并行、深度学习、高频数据 |

增值服务:

-

预装量化环境:Python 3.11 + Qlib 0.9.3 + TDXQuant + LightGBM 4.0,开箱即用

-

数据 pipeline 优化:通达信数据自动转Qlib二进制脚本,每日增量更新

-

性能调优咨询:针对您的策略特征(因子数量、股票池大小)定制硬件方案

结语:工欲善其事,必先利其器

当TDXQuant解决了"数据从哪来",当Qlib解决了"算法怎么用",剩下的就是"算力够不够快"。

在量化投资的进化论中,策略的复杂度与数据的维度永远在与算力的边界赛跑。当你想从2只ETF扩展到全市场5000只股票,当你想从5个基础因子升级到1000个Alpha因子,当你想从日频回测迈向分钟级滚动训练——一台专业的量化工作站,就是您策略生产力的放大器。

数据已来,AI已来,算力已就绪。下一个跑赢大盘的,就是您。

技术咨询:西安坤隆计算机科技有限公司 UltraLAB量化金融事业部

专业领域:Qlib平台部署、LightGBM训练优化、通达信数据基建

UltraLAB图形工作站供货商:

西安坤隆计算机科技有限公司

国内知名高端定制图形工作站厂家

业务电话:400-705-6800

咨询微信号:xasun001

上一篇:没有了